Famílias de vítimas processam dona do ChatGPT por massacre que deixou 8 mortos no Canadá

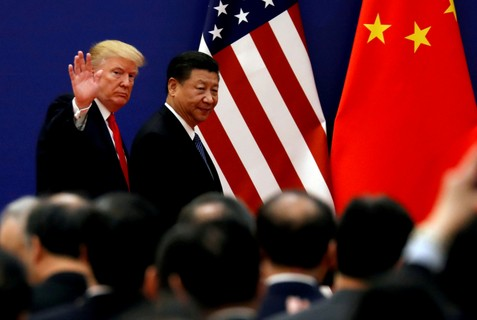

Homenagem às vítimas do massacre que deixou nove mortos em uma escola de Tumbler Ridge, no Canadá, em fevereiro de 2026 Christinne Muschi/The Canadian Press via AP Familiares das vítimas de um dos massacres mais mortais da história do Canadá entraram com um processo contra a OpenAI, dona do ChatGPT, e o CEO Altman, em um tribunal dos EUA, nesta quarta-feira (29). No massacre ocorrido em fevereiro em Tumbler Ridge, na Colúmbia Britânica, uma atiradora matou oito pessoas, muitas deles crianças, e cometeu suicídio em seguida. ???? Assine a newsletter do Guia de Compras do g1 com testes e dicas de tecnologia Segundo a alegação dos familiares, a empresa identificou a atiradora, chamada Jesse Van Rootselaar, como uma potencial ameaça oito meses antes do ataque, mas não alertou a polícia. Na semana passada, um jornal local de Tumbler Ridge publicou uma carta aberta na qual Altman disse estar “profundamente arrependido” pelo fato de a conta da atiradora não ter sido sinalizada às autoridades. Vídeos em alta no g1 Veja mais: Altman pede desculpas por não ter alertado a polícia sobre atiradora de massacre no Canadá As ações judiciais, apresentadas no tribunal federal de São Francisco, acusam os líderes da OpenAI de não alertarem a polícia porque isso iria expor o volume de conversas relacionadas à violência no ChatGPT e poderia colocar em risco o caminho da empresa de buscar uma oferta pública inicial de quase US$ 1 trilhão. Um porta-voz da OpenAI classificou o tiroteio como “uma tragédia” e disse que a empresa tem uma política de tolerância zero para o uso de suas ferramentas na facilitação de atos violentos. “Como compartilhamos com as autoridades canadenses, já fortalecemos nossas salvaguardas, incluindo a melhoria de como o ChatGPT responde a sinais de angústia, conectando pessoas com suporte local e recursos de saúde mental, reforçando como avaliamos e escalamos ameaças potenciais de violência e aprimorando a detecção de reincidência de violadores de políticas”, disse o porta-voz em comunicado. Onda de processos Os casos fazem parte de uma onda crescente de processos acusando empresas de inteligência artificial de não prevenirem interações em chatbots que, segundo os autores, contribuem para automutilação, doenças mentais e violência. Essas acusações são as primeiras, nos EUA, a alegar que o ChatGPT teve um papel na facilitação de um massacre. Jay Edelson, que representa os autores do processo, disse que planeja apresentar mais duas dezenas de ações judiciais nas próximas semanas contra a OpenAI, em nome de outras pessoas impactadas pelo tiroteio. Vítimas do ataque em escola e casa em cidade do Canadá Divulgação/RCMP.CA Equipe de segurança da OpenAI foi ignorada, dizem ações Jesse Van Rootselaar, cujas interações com o ChatGPT estão no centro dos processos, atirou em sua mãe e meio-irmão em casa antes de matar uma assistente educacional e cinco alunos de 12 a 13 anos em sua antiga escola em 10 de fevereiro, segundo a polícia. Van Rootselaar, que tinha 18 anos, cometeu suicídio em seguida. Os autores do processo incluem familiares dos mortos na escola e uma menina de 12 anos que sobreviveu após ser baleada três vezes, mas permanece em terapia intensiva. De acordo com uma das queixas, os sistemas automatizados da OpenAI, em junho de 2025, sinalizaram conversas no ChatGPT nas quais a atiradora descrevia cenários de violência armada. Membros da equipe de segurança recomendaram contatar a polícia após concluírem que ela representava uma ameaça crível e iminente de dano, segundo a queixa, que cita um artigo do Wall Street Journal de fevereiro sobre discussões internas da empresa. Mas Sam Altman e outros líderes da OpenAI teriam ignorado a recomendação da equipe de segurança e a polícia nunca foi chamada, alega o processo. A conta da atiradora foi desativada, mas ela conseguiu criar uma nova conta e continuar usando a plataforma para planejar o ataque, afirma o processo. Após a publicação do artigo do Wall Street Journal, a empresa disse que a conta foi sinalizada por sistemas que identificam “usos indevidos de nossos modelos para atividades violentas”, mas que as questões não atenderam aos critérios internos para notificação às autoridades. Em um blog publicado na terça-feira (28), a OpenAI disse que treina seus modelos para recusar solicitações que possam “facilitar significativamente a violência” e notifica as autoridades quando conversas sugerem “um risco iminente e crível de dano a outros”, com especialistas em saúde mental ajudando a avaliar casos limítrofes. A empresa afirmou que continuamente aprimora seus modelos e métodos de detecção com base no uso e em opiniões de especialistas. Os processos buscam uma quantia não revelada publicamente em indenizações e uma ordem judicial exigindo que a OpenAI reformule suas práticas de segurança, incluindo protocolos obrigatórios de notificação às autoridades. Uma das vítimas inicialmente entrou com uma ação no Canadá, mas desistiu e acabou decidindo processar n

Homenagem às vítimas do massacre que deixou nove mortos em uma escola de Tumbler Ridge, no Canadá, em fevereiro de 2026 Christinne Muschi/The Canadian Press via AP Familiares das vítimas de um dos massacres mais mortais da história do Canadá entraram com um processo contra a OpenAI, dona do ChatGPT, e o CEO Altman, em um tribunal dos EUA, nesta quarta-feira (29). No massacre ocorrido em fevereiro em Tumbler Ridge, na Colúmbia Britânica, uma atiradora matou oito pessoas, muitas deles crianças, e cometeu suicídio em seguida. ???? Assine a newsletter do Guia de Compras do g1 com testes e dicas de tecnologia Segundo a alegação dos familiares, a empresa identificou a atiradora, chamada Jesse Van Rootselaar, como uma potencial ameaça oito meses antes do ataque, mas não alertou a polícia. Na semana passada, um jornal local de Tumbler Ridge publicou uma carta aberta na qual Altman disse estar “profundamente arrependido” pelo fato de a conta da atiradora não ter sido sinalizada às autoridades. Vídeos em alta no g1 Veja mais: Altman pede desculpas por não ter alertado a polícia sobre atiradora de massacre no Canadá As ações judiciais, apresentadas no tribunal federal de São Francisco, acusam os líderes da OpenAI de não alertarem a polícia porque isso iria expor o volume de conversas relacionadas à violência no ChatGPT e poderia colocar em risco o caminho da empresa de buscar uma oferta pública inicial de quase US$ 1 trilhão. Um porta-voz da OpenAI classificou o tiroteio como “uma tragédia” e disse que a empresa tem uma política de tolerância zero para o uso de suas ferramentas na facilitação de atos violentos. “Como compartilhamos com as autoridades canadenses, já fortalecemos nossas salvaguardas, incluindo a melhoria de como o ChatGPT responde a sinais de angústia, conectando pessoas com suporte local e recursos de saúde mental, reforçando como avaliamos e escalamos ameaças potenciais de violência e aprimorando a detecção de reincidência de violadores de políticas”, disse o porta-voz em comunicado. Onda de processos Os casos fazem parte de uma onda crescente de processos acusando empresas de inteligência artificial de não prevenirem interações em chatbots que, segundo os autores, contribuem para automutilação, doenças mentais e violência. Essas acusações são as primeiras, nos EUA, a alegar que o ChatGPT teve um papel na facilitação de um massacre. Jay Edelson, que representa os autores do processo, disse que planeja apresentar mais duas dezenas de ações judiciais nas próximas semanas contra a OpenAI, em nome de outras pessoas impactadas pelo tiroteio. Vítimas do ataque em escola e casa em cidade do Canadá Divulgação/RCMP.CA Equipe de segurança da OpenAI foi ignorada, dizem ações Jesse Van Rootselaar, cujas interações com o ChatGPT estão no centro dos processos, atirou em sua mãe e meio-irmão em casa antes de matar uma assistente educacional e cinco alunos de 12 a 13 anos em sua antiga escola em 10 de fevereiro, segundo a polícia. Van Rootselaar, que tinha 18 anos, cometeu suicídio em seguida. Os autores do processo incluem familiares dos mortos na escola e uma menina de 12 anos que sobreviveu após ser baleada três vezes, mas permanece em terapia intensiva. De acordo com uma das queixas, os sistemas automatizados da OpenAI, em junho de 2025, sinalizaram conversas no ChatGPT nas quais a atiradora descrevia cenários de violência armada. Membros da equipe de segurança recomendaram contatar a polícia após concluírem que ela representava uma ameaça crível e iminente de dano, segundo a queixa, que cita um artigo do Wall Street Journal de fevereiro sobre discussões internas da empresa. Mas Sam Altman e outros líderes da OpenAI teriam ignorado a recomendação da equipe de segurança e a polícia nunca foi chamada, alega o processo. A conta da atiradora foi desativada, mas ela conseguiu criar uma nova conta e continuar usando a plataforma para planejar o ataque, afirma o processo. Após a publicação do artigo do Wall Street Journal, a empresa disse que a conta foi sinalizada por sistemas que identificam “usos indevidos de nossos modelos para atividades violentas”, mas que as questões não atenderam aos critérios internos para notificação às autoridades. Em um blog publicado na terça-feira (28), a OpenAI disse que treina seus modelos para recusar solicitações que possam “facilitar significativamente a violência” e notifica as autoridades quando conversas sugerem “um risco iminente e crível de dano a outros”, com especialistas em saúde mental ajudando a avaliar casos limítrofes. A empresa afirmou que continuamente aprimora seus modelos e métodos de detecção com base no uso e em opiniões de especialistas. Os processos buscam uma quantia não revelada publicamente em indenizações e uma ordem judicial exigindo que a OpenAI reformule suas práticas de segurança, incluindo protocolos obrigatórios de notificação às autoridades. Uma das vítimas inicialmente entrou com uma ação no Canadá, mas desistiu e acabou decidindo processar na Califórnia, segundo Edelson. OpenAI enfrenta ações na Justiça Os processos relacionados ao tiroteio em Tumbler Ridge ocorrem após várias ações judiciais terem sido movidas contra a OpenAI em tribunais estaduais e federais dos EUA nos últimos meses, alegando que o ChatGPT facilitou comportamentos prejudiciais, suicídio e, em pelo menos um caso, um assassinato seguido de suicídio. Os processos, que ainda estão em fases iniciais, pressionarão os tribunais a lidar com o papel que uma plataforma de IA pode desempenhar na promoção da violência e se a empresa pode ser responsabilizada por suas ações ou pelas ações de seus usuários. A OpenAI negou as alegações nos processos, argumentando, no caso do assassinato-suicídio, que o autor tinha um longo histórico de doença mental. O procurador-geral da Flórida, James Uthmeier, anunciou no início deste mês uma investigação criminal sobre o papel do ChatGPT em um tiroteio ocorrido em 2025 na Universidade Estadual da Flórida.

Qual é a sua reação?